阿里云宣布自研EMO模型上线通义App-用照片加音频生成唱歌视频

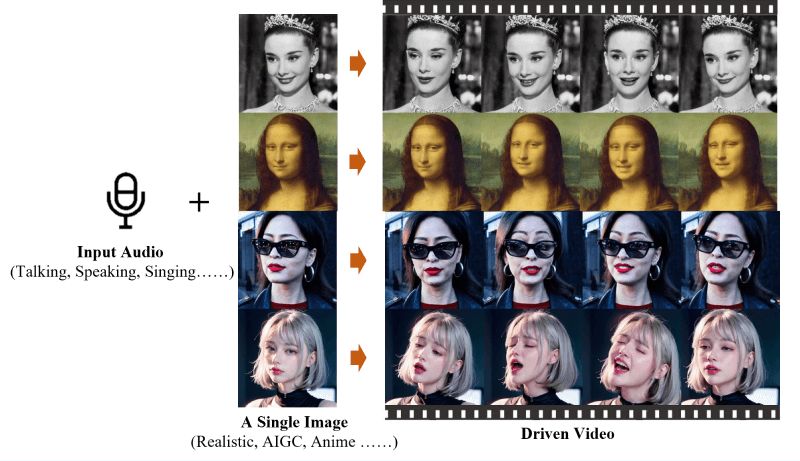

阿里云宣布自研EMO模型上线通义App,用照片加音频生成唱歌视频。EMO:阿里研发的AI肖像视频生成系统,以单图+音频创造表情生动、头部动作丰富的视频。现已免费上线通义App,支持选模板、传照片合成表演视频。首批80多模板含热门歌曲、网络热梗。特点:音频驱动、高逼真度、无缝帧过渡、身份保持、稳健控制、灵活时长、跨语言与风格。

通义App新闻详情

EMO(EmotePortraitAlive),是由阿里巴巴集团智能计算研究院研发的一个音频驱动的AI肖像视频生成系统。该系统能够仅凭借一张参考图像与一段语音音频,创造出包含丰富表情与多样头部动作的视频内容。

今日,阿里云宣布通义实验室研发的AI模型——EMO已在通义App正式上线,并向全体用户免费开放使用。用户现在可选择歌曲、网络热梗或表情包模板,在上传个人肖像照片后,利用EMO功能合成表演歌唱的趣味视频。

通义App首批上线了超过80款EMO模板,涵盖热门歌曲如《上春山》、《野狼Disco》,以及网络流行语“钵钵鸡”、“回手掏”等,但目前尚不支持用户自定义音频上传。

EMO的主要特性包括:

-音频驱动的视频生成:EMO能够直接依据输入的音频(如语音或歌声)实时生成对应视频,无需依赖预先录制的视频片段或复杂的3D面部模型。

-高表现力与逼真度:生成的视频具备极高的表情表现力,精准捕捉并重现人类面部细微表情变化,包括微妙的微表情,以及与音频节拍同步的头部动作。

-无缝帧过渡:EMO确保视频帧之间过渡自然平滑,有效避免面部失真或帧间晃动现象,显著提升整体视频质量。

-身份保持:通过FrameEncoding模块,EMO能够在生成过程中始终保持角色身份一致性,确保角色形象与输入的参考图像完全吻合。

-稳健的控制机制:系统采用速度控制器与面部区域控制器等稳定化技术,强化视频生成过程的稳定性,防止生成过程中出现崩溃等问题。

-灵活的视频时长:EMO可根据输入音频的长度自适应生成任意长度的视频,赋予用户充分的创意自由度。

-跨语言与跨风格:EMO的训练数据集覆盖了中文、英文等多种语言,以及现实主义、动漫、3D等多种风格,使其能够适应不同文化和艺术风格的需求。

- 阿里云通义千问App上线通义舞王-一张照片就能生成跳舞视频[01-05]

- 通义千问邀请码怎么获得-阿里云大模型邀请码获取方法攻略[04-16]

- 通义千问app网站入口怎么进入-阿里通义千问网站地址[04-14]

- 微软计划将Sora视频生成模型整合进Copilot-但需时日[02-22]

- OpenAI王炸-新Sora模型一句话生成1分钟视频效果接近实拍[02-24]

- 谷歌希望未来数周内重新上线Gemini模型人像生成功能-正在修复问题[02-28]

- 苹果正自研设备端大型语言模型-赋能AI功能[04-22]

- 阿里云盘在哪关闭自动生成回忆-阿里云盘关闭自动生成回忆的方法[12-26]

- 全民K歌录视频唱歌在哪里-全民K歌录视频唱歌教程[02-24]

- 萤石云视频app怎么看视频回放-萤石云视频app查看视频回放教程[05-05]

-

1

-

2

-

3

-

4

-

5

-

6

-

7

-

1

-

2

-

3

-

4

-

5

-

6

-

7